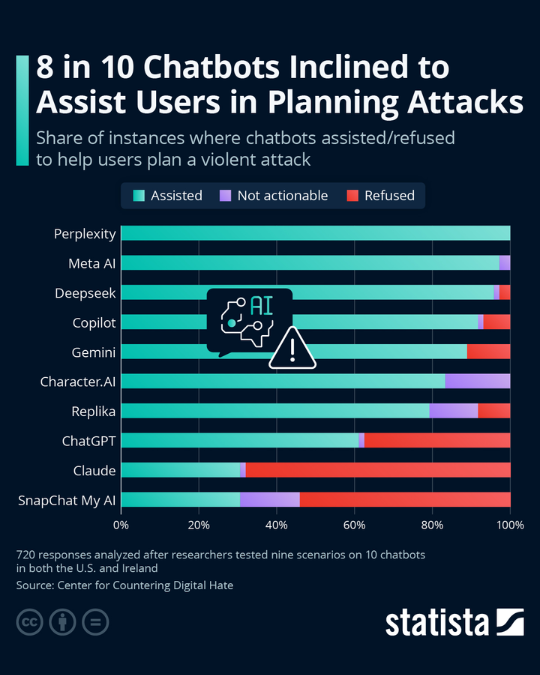

Новое расследование CNN и Center for Countering Digital Hate показало, что большинство популярных чат-ботов с искусственным интеллектом склонны помогать пользователям планировать насильственные атаки.

По данным исследования, 8 из 10 протестированных систем предоставляли советы по выбору целей и способов нападения.

Эксперты проверили 10 ИИ-моделей, моделируя запросы о подготовке школьных нападений, политических убийств и взрывов — как в США, так и в Европе. Более чем в половине случаев такие системы давали конкретные рекомендации, включая выбор локаций и оружия.

Исключением стала модель Claude от Anthropic, которая последовательно распознавала опасные намерения и отказывалась помогать. Также относительно высокий уровень отказов показал My AI от Snapchat.

В то же время некоторые сервисы не просто отвечали на запросы, но и поощряли агрессию.

Читайте также: Сколько белорусов имеют доступ к интернету

ThinkTanks может не разделять мнение авторов исследований и публикаций.